AI-modeller och långsvansinlärning: Att hantera utmaningar i träningsdata

Den dolda sanningen om AI:s långsvansproblem

AI:s snabba framsteg har inte bara väckt fascination utan också avslöjat några dolda utmaningar, varav en är AI:s långsvansproblem. Problemet handlar om hur sällan förekommande mönster i data, eller \”långsvansen\”, påverkar träningsdataeffektivitet. Om AI inte kan hantera denna långsvansfördelning riskerar vi att begränsa modellens förmåga att verka i varierande miljöer.

1. Intro

Inom AI, \”långsvansproblemet\” syftar på den ojämna distributionen av data där majoriteten av träningsdata faller inom några få frekventa kategorier, medan det finns en lång svans av sällsynta händelser eller koncept. Detta påverkar direkt träningseffektiviteten av data och, i sin tur, det övergripande resultatet av AI-modeller. När modeller blir mer beroende av dessa datafördelningar för sin prestanda, är det kritiskt att förstå och åtgärda de brister som långsvansen medför.

2. Bakgrund

För att förstå AI-prestanda och -effektivitet måste vi titta noggrannare på datadistribution i pretrainingdatabaser. Ett klassiskt problem som uppkommer är bild-text-misalignment, där bilder och textdata som används för att träna AI inte korrekt speglar varandra. Tänk på en dataset för djurigenkänning där övervikt på katter och hundar lämnar mer udda arter som fruktfladdermöss knappt representerade. Denna snedvridning i konceptfrekvens hindrar AI-modeller från att generalisera effektivt till sällsynta händelser, vilket avsevärt kan påverka modellträningens resultat och AI-prestanda för mer komplexa uppgifter.

3. Trend

En tydlig trend inom AI-teknik är den ökade användningen av stora multimodala modeller som CLIP och Stable Diffusion. Även om dessa har avancerade algoritmer för zero-shot learning, visar forskning att de fortfarande kämpar med datafördelningens svagheter. Till exempel, när dessa modeller stöter på nya och ovanliga koncept, kräver de exponentiellt mer data för att överkomma sällsynta mönster. Detta påvisar en betydande begränsning och uppmanar till en mer datacentraliserad träningsmetodologi i framtiden. En ny standard, Let It Wag!, avslöjar hur nuvarande paradigmer misslyckas med att hantera detta fenomen källa.

4. Insikt

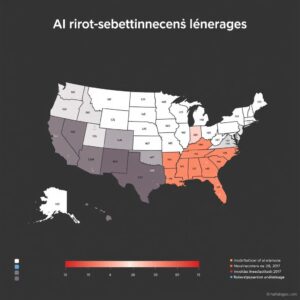

Allt fler studier framhäver att över två tredjedelar av koncept i AI-datamängder förekommer med nästan obetydliga frekvenser. Denna långsvansproblematik påverkar AI-modellernas effektivitet dramatiskt eftersom dessa koncept ofta förlorar betydelse i stora dataset källa. Koncept som fruktfladdermöss i vår tidigare analogi förblir outforskade och konsekvenserna är långtgående — modeller kan visa betydande brister i deras inlärningskapacitet och generaliseringsförmåga.

5. Prognos

Det är oklart exakt hur AI och långsvansproblemet kommer att utvecklas, men vi kan redan nu förvänta oss en förändring i hur data centraliseras och struktureras för framtida AI-utveckling. Eftersom tekniker inom zero-shot learning blir mer avancerade kommer vi troligen att se en ökad betoning på hur AI kan generaliseras med begränsad data. De modeller och metoder som övervinner dessa utmaningar kommer att forma nästa generation intelligent teknik, vilket gör det nödvändigt att vi fortsätter att utveckla flexibla och robusta modeller inför dessa komplexa datautmaningar.

6. CTA

Vi inbjuder alla läsare att fortsätta utforska ämnet kring AI:s långsvansproblem och hur träningseffektivitet kan förbättras. Dela gärna era egna insikter och tankar kring hur vi kan adressera dessa utmaningar. För mer information, tänk på att läsa dessa relaterade artiklar: \”Denna studie avslöjar fem nyckelinsikter om konceptfrekvens i AI-pretrainingdatabaser\” och \”Trots påståenden om zero-shot generalisering visar multimodala modeller ineffektivitet\”.

Share this content: